index●comunicación

Revista científica de comunicación aplicada

nº 16(1) 2026 | Páginas 37-69

e-ISSN: 2174-1859 | ISSN: 2444-3239

Comunicación persuasiva con IA:

personalización, confianza y retos éticos

Persuasive

Communication with Ai:

Personalization, Trust and Ethical Challenges

Recibido el 26/05/2025 | Aceptado el 26/10/2025 | Publicado el 15/01/2026

https://doi.org/10.62008/ixc/16/01Comuni

Aitor Gil García | Universidad Camilo José Cela

aitor.gil@ucjc.edu | https://orcid.org/0009-0005-1133-7842

África Presol Herrero | Universidad Camilo José Cela

apresol@ucjc.edu | https://orcid.org/0000-0002-7600-8231

Resumen: Este estudio analiza el impacto de la inteligencia artificial (IA) en la comunicación persuasiva en marketing digital, con énfasis en los procesos de personalización, la confianza del consumidor y los retos éticos asociados. Se aplicó un diseño exploratorio secuencial con enfoque metodológico mixto, integrando entrevistas semiestructuradas a responsables de marketing de 50 empresas y encuestas estructuradas a 500 consumidores. Los resultados muestran mejoras significativas en conversión, engagement y satisfacción, pero también revelan preocupaciones crecientes sobre privacidad y manipulación algorítmica. Se concluye que la integración de IA en estrategias de marketing debe incorporar supervisión humana y principios éticos sólidos. Esta investigación constituye una contribución científica innovadora al proponer un modelo responsable que integra eficacia persuasiva y ética mediante una aplicación transparente y centrada en el usuario de la inteligencia artificial.

Palabras clave: inteligencia artificial; comunicación persuasiva; marketing digital; personalización; ética algorítmica; confianza del consumidor.

Abstract: This study analyzes the impact of artificial intelligence (AI) on persuasive communication in digital marketing, with emphasis on personalization, consumer trust, and ethical challenges. A sequential exploratory mixed-methods design was applied, combining semi-structured interviews with marketing professionals from 50 companies and structured surveys with 500 consumers. Results show significant improvements in conversion, engagement, and satisfaction, but also increasing concerns about privacy and algorithmic manipulation. The study concludes that integrating AI into marketing strategies requires human oversight and strong ethical principles. This research constitutes an innovative scientific contribution by proposing a responsible model that integrates persuasive effectiveness and ethics through a transparent and user-centered application of artificial intelligence.

Keywords: Artificial Intelligence; Persuasive Communication; Digital Marketing; Personalization; Algorithmic Ethics; Consumer Trust.

CC BY-NC 4.0

Para citar este trabajo: Gil García, A. y Presol Herrero, Á. (2026). Comunicación persuasiva con IA: personalización, confianza y retos éticos. index.comunicación, 16(1), 37-69. https://doi.org/10.62008/ixc/16/01Comuni

1. Introducción

La inteligencia artificial (IA) ha pasado de ser una herramienta auxiliar para convertirse en un emisor activo dentro del ecosistema digital. Su capacidad para segmentar audiencias, personalizar contenidos y automatizar mensajes está transformando la comunicación, desplazando parcialmente la autoría humana. Este cambio plantea desafíos éticos y culturales, al introducir mensajes generados por sistemas que carecen de conciencia, pero que influyen en la construcción del sentido y la interacción social (Kaplan & Haenlein, 2019).

Startups y pymes, tradicionalmente limitadas por sus recursos, han encontrado en la IA una oportunidad para competir en igualdad de condiciones con grandes empresas (Lee et al., 2023). Herramientas como la automatización de contenidos, los motores de recomendación y los chatbots conversacionales optimizan procesos, reducen costes y permiten diseñar experiencias hiperpersonalizadas ajustadas a las emociones, hábitos y decisiones cotidianas de cada usuario (Sundar, 2020).

Sin embargo, el potencial de la IA no está exento de fricciones. ¿Qué ocurre cuando un sistema persuade sin que el usuario sea consciente? ¿Cómo afecta esto a la confianza en la marca, a la autonomía del consumidor o al consentimiento informado? En esta investigación, se define la comunicación persuasiva con IA (o persuasión algorítmica) como el uso estratégico de algoritmos inteligentes para influir deliberadamente en las decisiones o comportamientos de los usuarios mediante la personalización automatizada de mensajes a gran escala, integrando procesos de segmentación, recomendación y adaptación continua (Zarouali et al.,2022). Numerosos estudios alertan sobre los riesgos asociados a la opacidad algorítmica, los sesgos automatizados y el uso poco ético de datos en entornos digitales (Floridi et al., 2018; Mittelstadt et al., 2016; Raji et al., 2020). Todo ello sitúa a la IA en el centro de un debate clave: la necesidad de construir una comunicación persuasiva ética, transparente y centrada en las personas.

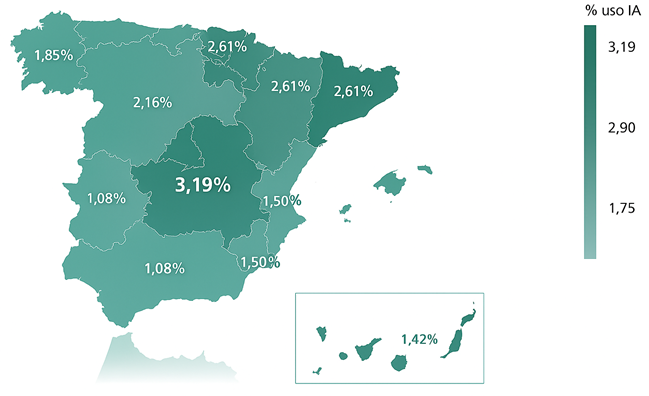

A nivel nacional, el grado de adopción de la IA por parte de las pymes sigue siendo limitado: según el informe de IndesIA (2024), apenas un 2,13% de estas empresas hacen referencia explícita a su uso. Además, existe una disparidad territorial significativa. Algunas comunidades autónomas como Madrid alcanzan en torno al 3% de adopción, mientras que otras zonas como Castilla-La Mancha o Extremadura apenas llegan al 0,5%. Esta brecha regional puede tener implicaciones relevantes en términos de competitividad, desarrollo económico y acceso a la innovación, especialmente en el ámbito de las pequeñas empresas. En el ámbito europeo, un 13,5% de las empresas de la UE con más de 10 empleados utiliza tecnologías de IA (Eurostat, 2025), y la Comisión Europea ha lanzado nuevas iniciativas para apoyar a startups y pymes en su transformación digital (European Commission, 2024). Sin embargo, el Tribunal de Cuentas Europeo (2024) advierte de que persisten brechas importantes entre grandes corporaciones y empresas emergentes en madurez tecnológica.

Figura 1. Porcentaje de uso de inteligencia artificial

por parte de las pymes españolas

por comunidad autónoma

Fuente: IndesIA (2024),

Barómetro de adopción de la IA en las pymes españolas.

Imagen original extraída del informe oficial. Análisis: datos secundarios

(resultados de un estudio nacional).

Pese al creciente interés académico y empresarial en la IA aplicada al marketing, existe un vacío en la literatura sobre cómo estas tecnologías están siendo aplicadas en el tejido empresarial español. Además, el impacto comunicativo de dichas implementaciones rara vez se estudia desde un enfoque que integre lo operativo con lo ético y lo educativo. En este sentido, el presente estudio también aporta al campo de la educomunicación, al analizar cómo los responsables de marketing comprenden, adoptan y comunican las capacidades de la IA, y en qué medida estas prácticas se alinean —o no— con modelos de comunicación inclusivos, críticos y conscientes (Nagamini & Aguaded, 2018).

En este contexto, el presente estudio analiza el impacto de la IA en la comunicación persuasiva digital de startups y pymes españolas, evaluando tanto sus beneficios operativos como los desafíos éticos que plantea. Para ello, se adopta un enfoque metodológico mixto, concretamente un diseño exploratorio secuencial (DEXPLOR-S), que comienza con una fase cualitativa para explorar un fenómeno complejo y posteriormente valida y expande los hallazgos mediante instrumentos cuantitativos (Creswell & Plano Clark, 2017; Hernández-Sampieri et al., 2014). En concreto, se realizaron 50 entrevistas semiestructuradas a responsables de marketing y comunicación de empresas reales, complementadas con encuestas estructuradas a 500 consumidores que habían interactuado con campañas impulsadas por IA. El análisis cualitativo se realizó con Atlas.ti y el cuantitativo con Jamovi, permitiendo un tratamiento riguroso, transparente y replicable de los datos. Esta triangulación metodológica permite contrastar discursos corporativos y percepciones ciudadanas, trazando así una radiografía actualizada del papel de la IA en la comunicación persuasiva.

El artículo se organiza así: tras esta introducción, se presenta el marco teórico con los principales antecedentes, fundamentos conceptuales y vacíos investigativos. A continuación, se exponen los objetivos del estudio y las hipótesis planteadas. Posteriormente, se describe la metodología empleada, se analizan los resultados obtenidos y, finalmente, se discuten las implicaciones comunicativas, éticas y estratégicas del uso de IA, formulando conclusiones y propuestas para una implementación responsable en entornos empresariales.

2. Marco teórico

El presente marco teórico se estructura en torno a cuatro ejes principales. En primer lugar, se analiza cómo la inteligencia artificial se ha consolidado como un componente clave de la comunicación estratégica entre marcas y audiencias. A continuación, se examina su adopción en pymes y startups, con énfasis en los casos de uso más habituales y su contribución a la optimización de procesos y estrategias comerciales. Posteriormente, se aborda la persuasión algorítmica y su impacto en la percepción ciudadana y la ética de la comunicación digital, entendiendo la IA no solo como un recurso, sino como un nuevo emisor persuasivo en los entornos digitales. Finalmente, se integra la perspectiva educomunicativa, proponiendo un modelo conceptual responsable que equilibre eficacia persuasiva, ética y valores humanos.

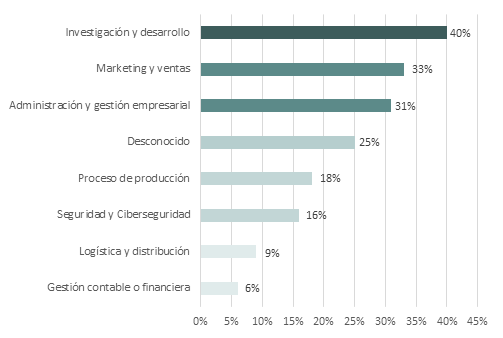

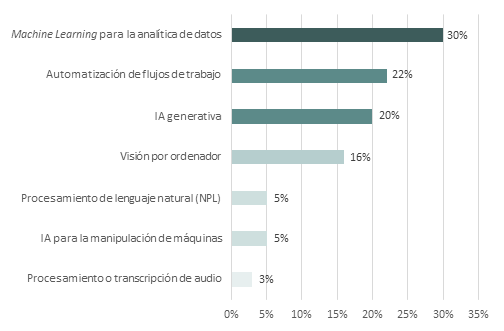

En este sentido, resulta relevante observar cómo las pymes españolas están utilizando la inteligencia artificial. La Figura 2 muestra los principales casos de uso, donde el marketing y las ventas ocupan el segundo lugar (33%), por detrás de la investigación y desarrollo (40%). Este dato refuerza la importancia de estudiar el impacto comunicativo de la IA en contextos empresariales emergentes. Por otro lado, la Figura 3 evidencia qué tecnologías están siendo utilizadas con mayor frecuencia. Predominan el machine learning aplicado a la analítica de datos (30%), la automatización de flujos de trabajo (22%) y la IA generativa (20%), todas con un fuerte componente comunicativo, especialmente en procesos de personalización, creación de contenido automatizado y toma de decisiones en tiempo real.

Figura 2. Porcentaje de pymes españolas que utilizan inteligencia artificial por área funcional

Fuente: IndesIA (2024).

Barómetro de adopción de la IA en las pymes españolas.

Análisis de datos secundarios de un estudio sectorial.

Figura 3. Porcentaje

de pymes españolas que utilizan distintas tecnologías

de inteligencia artificial

Fuente: IndesIA (2024). Barómetro

de adopción de la IA en las pymes españolas.

Análisis de datos secundarios de un estudio sectorial.

Diversos estudios recientes confirman la adopción progresiva de la IA en pymes y startups. En España, el Barómetro IndesIA (2024) indica que más de la mitad de las pymes ya emplea IA en marketing y comunicación digital. Sin embargo, este avance no es percibido de forma homogénea. Torres-Toukoumidis et al. (2024) advierten que la percepción social de la IA varía en función de la familiaridad tecnológica, el nivel educativo o el contexto de uso. Por ello, resulta fundamental comprender cómo distintos grupos interpretan la personalización algorítmica: como una mejora en la experiencia de usuario o como una amenaza a su privacidad. Esta dimensión comunicativa requiere el diseño de estrategias que integren ética, transparencia y control por parte del usuario, con el objetivo de garantizar relaciones digitales basadas en la confianza (Eubanks, 2018).

2.1. Inteligencia artificial y comunicación estratégica

La IA ha dejado de ser una herramienta de soporte en el ámbito del marketing para convertirse en un eje estratégico que redefine la comunicación entre marcas y audiencias (Grewal & Roggeveen, 2017). Mediante algoritmos avanzados, las empresas personalizan mensajes, anticipan comportamientos y optimizan interacciones en tiempo real, transformando la persuasión en un proceso automatizado, dinámico y altamente adaptable (Russell & Norvig, 2020). Este cambio se traduce en mejoras sustanciales en métricas clave como el engagement, la conversión y la fidelización (Kumar et al., 2021). Esta evolución mejora la eficacia de las campañas digitales, pero también plantea desafíos relacionados con la transparencia, la privacidad y la autonomía del usuario (Gunning & Aha, 2019). En este nuevo entorno, la IA actúa como un interlocutor invisible que aprende, se adapta y evoluciona con cada interacción. La persuasión deja de depender exclusivamente de la intención humana, distribuyéndose entre humanos y algoritmos capaces de interpretar datos, predecir reacciones y generar respuestas comunicativas personalizadas (Longoni et al., 2019).

2.2. Aplicaciones de IA en startups y pymes

Para startups y pymes, la IA se ha consolidado como una herramienta clave para mejorar la competitividad. Estas organizaciones, antes limitadas por sus recursos, ahora acceden a tecnologías que previamente solo estaban al alcance de grandes corporaciones (Tadimarri et al., 2024). Actualmente, pueden analizar datos en tiempo real, automatizar decisiones estratégicas y desarrollar estrategias comunicativas con un nivel de precisión antes inalcanzable, sin necesidad de realizar grandes inversiones previas (Suraña‐Sánchez & Aramendia‐Muneta, 2024).

En España se observan mejoras significativas: por ejemplo, el 61% de las pymes reporta aumentos en conversión y retención de clientes tras implementar soluciones de IA (IndesIA, 2024). No obstante, esta expansión plantea nuevos dilemas éticos y regulatorios. El Reglamento (UE) 2024/1689 —conocido como la Ley de IA europea— busca abordar estas tensiones estableciendo un marco común de transparencia y protección de derechos (European Union, 2024). En esta línea, estudios recientes subrayan la necesidad de equilibrar innovación y responsabilidad: Ngo (2025) destaca que la confianza del usuario depende de la transparencia y comprensibilidad de los procesos automatizados, mientras que Sebastião y Dias (2025) abogan por integrar marcos normativos sólidos que aseguren una aplicación ética de la IA en la comunicación digital.

2.3. Persuasión algorítmica, percepción ciudadana y ética

La IA se ha convertido en un agente persuasivo activo dentro de la comunicación estratégica (Davenport et al., 2020). Su capacidad para segmentar audiencias, automatizar campañas y adaptar mensajes en tiempo real ha transformado la forma en que las organizaciones interactúan con sus públicos. Plataformas como Amazon, Netflix o Spotify aplican la hiperpersonalización algorítmica para anticipar decisiones de consumo y generar experiencias adaptadas, consolidando la IA como un «interlocutor» invisible que aprende y evoluciona con cada interacción (Lee et al., 2023; Sundar, 2020).

Si bien estas innovaciones mejoran indicadores clave como la conversión o el engagement (Kumar et al., 2021), también generan tensiones éticas y perceptivas. La influencia persuasiva ahora se reparte entre humanos y algoritmos (Longoni et al., 2019): mientras algunos consumidores valoran positivamente la personalización algorítmica, otros la perciben como una amenaza a su privacidad o autonomía (Afroogh et al., 2024; Torres-Toukoumidis et al., 2024). Esto complementa la perspectiva de Eubanks (2018), quien subraya que la confianza digital depende no solo de la transparencia técnica sino del control efectivo que el usuario percibe sobre el sistema.

Recientes investigaciones señalan que la transparencia algorítmica es clave para generar confianza. Por ejemplo, Laux et al. (2024) demuestran que la transparencia mitiga la relación negativa entre actitudes generales hacia la IA y la confianza en las organizaciones que las emplean. En la Unión Europea, el Reglamento de IA (2024) promueve principios comunes de seguridad y explicabilidad, aunque autores como Ngo (2025) y Eubanks (2018) insisten en que, más allá de la regulación, se necesita un enfoque cultural y comunicativo de la ética, centrado en la experiencia del usuario.

En definitiva, el despliegue de la IA en comunicación plantea tensiones éticas significativas. Autores como Fernández-Fernández y Pinillos (2011) advierten que a mayor personalización aumenta el potencial de manipulación, mientras que Mittelstadt et al. (2016) muestran cómo los sesgos algorítmicos pueden reforzar desigualdades sociales. Kaplan y Haenlein (2019) enfatizan la necesidad de diseñar sistemas centrados en las personas y sujetos a rendición de cuentas. Estos enfoques sugieren que la ética de la IA no puede limitarse únicamente al plano técnico: requiere marcos integradores que consideren aspectos comunicativos, educativos y sociales para garantizar que las tecnologías sean auditables y alineadas con valores humanos.

2.4. Educomunicación y marco teórico integrador

La legitimidad de una comunicación persuasiva mediada por IA depende de que se garanticen condiciones como el consentimiento informado, la comprensibilidad del proceso algorítmico y la posibilidad de optar por alternativas no automatizadas (Jauregui & Ortega, 2020). Estas garantías, además de responder a exigencias legales, forman parte de un compromiso más amplio con la educomunicación, entendida como la promoción de la alfabetización digital crítica y del empoderamiento ciudadano para mantener una relación ética y consciente con los algoritmos (Nagamini & Aguaded, 2018; Zozaya Durazo et al., 2022).

La integración de los marcos comunicativo, ético y educomunicativo resulta esencial para abordar la persuasión algorítmica de manera integral. Desde la comunicación persuasiva se aportan las estrategias de influencia y eficacia; desde la ética de la IA, los principios de transparencia, justicia y responsabilidad; y desde la educomunicación, la alfabetización crítica y el empoderamiento ciudadano frente a la tecnología. Como sintetizan Torres-Toukoumidis et al. (2024), la articulación de estos tres enfoques no solo vincula innovación y valores, sino que redefine el papel del usuario como agente activo en la gobernanza algorítmica, ofreciendo un modelo de aplicación de la IA que considera tanto los objetivos empresariales como los derechos de la audiencia.

3. Objetivos del estudio

3.1. Objetivo general

Este estudio tiene como objetivo principal analizar el impacto de la inteligencia artificial en la comunicación persuasiva digital, evaluando su capacidad para personalizar mensajes, mejorar la eficacia de las estrategias de marketing y fortalecer la confianza del consumidor. Asimismo, se busca identificar los principales riesgos éticos asociados a su implementación, con especial atención a la privacidad, la manipulación algorítmica y la equidad comunicativa.

3.2. Objetivos específicos

A partir de este objetivo general, se plantean los siguientes objetivos específicos:

OE1. Analizar cómo las startups y pymes integran la IA en sus estrategias de comunicación persuasiva y marketing digital.

OE2. Evaluar el impacto de la IA en métricas clave como la conversión, el engagement y la satisfacción del cliente.

OE3. Explorar la percepción de los consumidores ante los mensajes personalizados generados por sistemas de IA.

OE4. Identificar los principales riesgos éticos asociados al uso de IA en comunicación, incluyendo la privacidad, los sesgos y la autonomía del usuario.

OE5. Proponer un modelo de implementación responsable de IA que combine eficacia comunicativa, supervisión humana y principios éticos.

3.3. Hipótesis de investigación

Con base en la revisión teórica y los objetivos del estudio, se formulan las siguientes hipótesis de investigación:

H1. La implementación de sistemas de inteligencia artificial en marketing digital mejora significativamente la tasa de conversión en startups y pymes.

H2. El uso de IA para la personalización de mensajes incrementa el engagement y la satisfacción del cliente.

H3. La percepción positiva de los consumidores hacia la IA está asociada a niveles altos de transparencia en el uso de datos y a una comunicación ética por parte de las marcas.

H4. La ausencia de supervisión humana en los sistemas basados en IA genera desconfianza en los consumidores y reduce la efectividad comunicativa.

H5. La adopción de un modelo híbrido que combine inteligencia artificial con control humano fortalece la confianza del consumidor y mejora la calidad de la relación marca-audiencia.

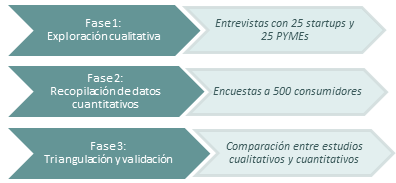

4. Metodología

Este estudio adopta un enfoque metodológico mixto, específicamente un diseño exploratorio secuencial (DEXPLOR-S), con el objetivo de analizar de manera integral el impacto de la IA en la comunicación persuasiva desarrollada por startups y pymes. Este enfoque combina métodos cualitativos y cuantitativos, lo que permite evaluar tanto indicadores objetivos —como la conversión, el engagement o el grado de personalización— como percepciones subjetivas, actitudes y barreras en la adopción de sistemas basados en IA. El trabajo de campo se desarrolló entre julio de 2024 y enero de 2025. La secuencia metodológica se inicia con una fase cualitativa orientada a explorar en profundidad las prácticas, estrategias y preocupaciones de los responsables de marketing y comunicación. A partir de los hallazgos emergentes, se diseña una fase cuantitativa posterior que los valida y amplía mediante una encuesta estructurada dirigida a consumidores (Creswell & Plano Clark, 2017). Este diseño permite una triangulación eficaz de datos y fortalece la validez analítica del estudio, al integrar de forma complementaria las perspectivas del entorno empresarial y de la experiencia del usuario (Torres-Toukoumidis et al., 2024).

4.1. Diseño de investigación y enfoque metodológico

En la fase cualitativa se entrevistó a 50 responsables de marketing y comunicación de 25 startups y 25 pymes españolas. El tamaño de la muestra se fijó para equilibrar diversidad sectorial y profundidad analítica, y la selección se realizó mediante muestreo intencional, priorizando organizaciones con experiencia documentada en el uso de inteligencia artificial aplicada a la comunicación. Las entrevistas se realizaron entre septiembre y noviembre de 2024 (duración media ≈ 30 minutos), se grabaron, transcribieron y analizaron temáticamente (Yin, 2017; Bryman, 2016) mediante codificación inductiva con Atlas.ti. Los instrumentos fueron validados previamente por expertos en comunicación digital y ética de datos. Con base en los criterios de inclusión propuestos por Yin (2017), las empresas seleccionadas cumplían requisitos como: operar en España, estar clasificadas oficialmente como startup o pyme (Comisión Europea, 2020), haber utilizado IA en los dos últimos años en marketing o atención al cliente, disponer de evidencia pública de dicho uso (webs, prensa o bases de datos sectoriales) y aplicar la IA con fines comunicativos (personalización, chatbots, etc.). Se excluyeron los casos en que la IA se aplicaba únicamente a procesos internos no vinculados con la comunicación externa.

En la fase cuantitativa se encuestó a 500 consumidores digitales residentes en España mediante muestreo por cuotas (edad, género, nivel educativo y experiencia digital). Los participantes habían interactuado previamente con campañas de marketing asistidas por IA. El cuestionario, validado por jueces expertos, midió variables como la confianza en sistemas basados en IA, la percepción de personalización, la valoración de la privacidad y la efectividad comunicativa. El análisis estadístico se realizó con Jamovi 2.4, aplicando correlaciones de Pearson, análisis factorial exploratorio y regresiones lineales múltiples. El instrumento mostró una alta consistencia interna (α de Cronbach = 0.81). El análisis descriptivo reveló que el 52% de los encuestados eran mujeres y el 48% hombres; el 63% tenía entre 25 y 45 años; el 78% residía en zonas urbanas y el 67% contaba con estudios universitarios.

Entre las principales limitaciones del estudio se identifican el muestreo de conveniencia (usuarios digitalizados) y la temporalidad postpandemia de la recolección cualitativa, que podrían haber sesgado algunas percepciones. No obstante, la validación de instrumentos por expertos y la triangulación metodológica mitigan dichos sesgos y refuerzan la credibilidad de los hallazgos. Más allá de los datos cuantitativos, este enfoque mixto permitió comprender cómo interactúan la tecnología y las personas en contextos reales, analizando de qué modo las percepciones profesionales y ciudadanas condicionan tanto la eficacia como la legitimidad de las estrategias automatizadas. La Figura 4 presenta un diagrama del enfoque metodológico secuencial (DEXPLOR-S) empleado en este estudio.

Figura 4. Diseño metodológico del estudio: enfoque mixto secuencial exploratorio (DEXPLOR-S)

Fuente: Elaboración propia. Análisis: esquema del proceso metodológico secuencial del estudio (fase cualitativa, cuantitativa y de triangulación).

4.2. Muestra del estudio

La muestra del estudio está compuesta por 50 empresas españolas, distribuidas equitativamente entre 25 startups y 25 pymes, seleccionadas por su aplicación documentada de inteligencia artificial en procesos de comunicación y marketing digital. La inclusión de ambos perfiles responde al interés por analizar el impacto de la IA en distintos niveles de madurez organizativa, partiendo de la premisa de que, aunque startups y pymes presentan estructuras diferenciadas, comparten desafíos comunes en la adopción de tecnologías disruptivas aplicadas a la comunicación persuasiva.

Desde un punto de vista técnico, se considera pyme —según la definición de la Comisión Europea (2020)— a toda empresa con menos de 250 empleados y un volumen de negocio inferior a 50 millones de euros. Por otra parte, se entiende por startup o empresa emergente aquella organización de reciente creación, con base tecnológica, alta capacidad de escalabilidad y operativa en contextos de incertidumbre e innovación intensiva (Ries, 2011). Esta diferenciación permite comparar la aplicación de IA en contextos estructurales distintos, desde modelos consolidados hasta entornos en construcción.

En este estudio se ha optado por integrar ambos perfiles por tres razones principales:

1. Porque representan sectores estratégicos dentro del tejido empresarial español y están implicados en procesos clave de transformación digital (Red.es, 2023).

2. Porque ambos tipos de empresa comparten necesidades de eficiencia comunicativa, captación y fidelización de clientes, áreas donde la IA puede ofrecer ventajas competitivas.

3. Porque la comparación entre startups y pymes permite observar diferencias y similitudes en la adopción de IA desde una perspectiva comunicativa, tecnológica y ética.

Los detalles específicos de esta muestra se desarrollan en los subapartados siguientes.

4.2.1. Muestra de pymes seleccionadas

La primera parte de la muestra cualitativa está integrada por 25 pymes españolas que implementan soluciones basadas en inteligencia artificial aplicadas específicamente a los ámbitos de la comunicación, el marketing digital o la atención automatizada al cliente. Todas ellas cumplen con los criterios de inclusión establecidos en el diseño metodológico del estudio y han sido validadas a través de fuentes públicas verificables.

La selección se llevó a cabo priorizando la diversidad sectorial (salud, legaltech, energía, movilidad, fintech, sostenibilidad, entre otros), así como el equilibrio entre diferentes modelos de negocio (B2B, B2C y mixtos). Asimismo, se procuró representar distintos niveles de madurez tecnológica e implementación de IA, desde empresas que emplean herramientas conversacionales básicas o CRM automatizados, hasta aquellas que aplican algoritmos de machine learning para segmentación predictiva, personalización dinámica de contenidos o scoring de leads.

Este conjunto de pymes permite analizar cómo organizaciones consolidadas —aunque limitadas en recursos frente a grandes corporaciones— están incorporando tecnologías avanzadas para optimizar su comunicación persuasiva, mejorar la experiencia del cliente y reforzar su competitividad en entornos digitales.

La información detallada sobre las pymes seleccionadas —incluyendo nombre, sector, modelo de negocio y tipo de tecnología basada en IA utilizada— se presenta en el Anexo 1.

4.2.2. Muestra de startups seleccionadas

La segunda mitad de la muestra cualitativa está compuesta por 25 startups españolas que emplean inteligencia artificial en estrategias de comunicación, marketing digital, personalización de contenidos o atención automatizada. Fueron seleccionadas a partir de un muestreo teórico-intencional, siguiendo los mismos criterios de inclusión detallados en el apartado 4.2, y verificadas mediante fuentes públicas actualizadas.

A diferencia de las pymes, las startups operan en entornos marcadamente volátiles, con un enfoque claro en la escalabilidad, el crecimiento acelerado y la innovación intensiva (Ries, 2011). En este sentido, su incorporación en la muestra permite observar cómo estas empresas integran la IA desde etapas tempranas como un componente estratégico clave para atraer clientes, automatizar procesos comunicativos y generar ventajas competitivas en el mercado. La muestra cumple con los criterios de inclusión definidos previamente, especialmente en cuanto a la existencia de evidencia pública, actual y verificable sobre el uso de IA con fines comunicativos. Se ha priorizado la representación de una amplia diversidad sectorial —salud digital, fintech, turismo, retail, legaltech, educación, entre otros— así como la inclusión de distintos enfoques tecnológicos: desde modelos generativos de lenguaje natural y asistentes conversacionales, hasta sistemas de visión por computador, algoritmos de segmentación predictiva o motores de recomendación personalizados. Esta parte de la muestra permite estudiar cómo la IA se concibe no solo como una herramienta de optimización, sino como un eje central de innovación comunicativa desde la génesis de cada proyecto. La información detallada sobre estas startups —incluyendo nombre, sector, modelo de negocio y tipo de tecnología de IA utilizada— se presenta en el Anexo 2.

4.2.3. Perfil de las personas entrevistadas

Como parte de la fase cualitativa del estudio, se realizaron entrevistas semiestructuradas a profesionales con responsabilidad directa en marketing, comunicación o estrategia digital en las empresas seleccionadas. Los perfiles fueron identificados a través de fuentes públicas —como LinkedIn, páginas corporativas y medios especializados— y seleccionados por su implicación en el diseño, implementación y evaluación de estrategias basadas en inteligencia artificial.

Las entrevistas, realizadas en modalidad online, tuvieron una duración media de entre 25 y 40 minutos y se estructuraron en cinco bloques temáticos: adopción de IA, herramientas utilizadas, impacto percibido en métricas, riesgos éticos y rol de la IA en la comunicación persuasiva, permitiendo flexibilidad para explorar aspectos emergentes. El 54% de las personas entrevistadas eran mujeres y el 46% hombres, con una media de edad de 41,8 años (rango entre 29 y 59). En cuanto a su formación, más del 70% contaba con estudios de postgrado en comunicación, marketing o áreas STEM. La distribución sectorial de las entrevistas refleja proporcionalmente los perfiles empresariales de la muestra general.

Para garantizar la privacidad de los informantes y cumplir con los principios éticos de la investigación cualitativa, los datos se presentan de forma anonimizada. El análisis temático se llevó a cabo mediante técnicas de codificación abierta y axial, siguiendo los protocolos de análisis cualitativo (Yin, 2017; Bryman, 2016). Se utilizó el software Atlas.ti (v.23) para organizar la codificación, detectar patrones emergentes y establecer relaciones entre categorías temáticas. La distribución detallada de los perfiles entrevistados se presenta en el Anexo 3, como parte del respaldo metodológico de esta fase del estudio.

4.3. Encuestas estructuradas a consumidores: percepción, confianza y ética

Como complemento a la fase cualitativa, se desarrolló un estudio cuantitativo mediante encuestas estructuradas dirigidas a una muestra de 500 consumidores que habían interactuado con campañas de marketing digital impulsadas por inteligencia artificial. Esta fase tuvo como finalidad contrastar empíricamente los hallazgos obtenidos en las entrevistas con responsables de empresas y, en particular, explorar cómo las audiencias perciben las estrategias persuasivas mediadas por IA.

La recolección de datos se llevó a cabo entre noviembre de 2024 y enero de 2025. El cuestionario fue diseñado a partir de estudios previos sobre percepción algorítmica, ética comunicativa y confianza digital (Torres-Toukoumidis et al., 2024; Floridi et al., 2018). Incluyó preguntas cerradas, escalas tipo Likert y opciones múltiples, organizadas en torno a las siguientes dimensiones clave:

a) Nivel de reconocimiento del uso de IA en la comunicación comercial.

b) Grado de aceptación de la personalización algorítmica.

c) Percepción de transparencia y manipulación.

d) Confianza en la automatización de los mensajes.

e) Valoración de la supervisión humana en los sistemas de IA.

f) Preocupación por el uso de datos personales.

El cuestionario fue sometido a un proceso de validación por expertos para garantizar la consistencia interna de las escalas empleadas. La muestra se obtuvo mediante un muestreo no probabilístico por conveniencia, seleccionando usuarios digitales que hubieran estado expuestos recientemente a campañas automatizadas procedentes de empresas emergentes o medianas. El análisis de los datos se realizó con el software estadístico Jamovi (versión 2.4), aplicando técnicas de análisis descriptivo, correlaciones bivariadas, regresión logística binaria y análisis factorial exploratorio (AFE) para identificar patrones latentes en la percepción y la confianza del consumidor (Hair et al., 2019). Se incluyeron variables demográficas y contextuales para segmentar los resultados por género, edad, sector laboral y nivel de alfabetización digital.

La integración de esta fase cuantitativa dentro del diseño exploratorio secuencial permitió validar las hipótesis planteadas y enriquecer el análisis mediante datos procedentes directamente de la ciudadanía. Este enfoque aportó una visión complementaria sobre cómo se interpreta la persuasión automatizada desde el punto de vista del receptor, y ofreció indicios relevantes sobre los factores que refuerzan —o erosionan— la confianza del consumidor frente a los sistemas inteligentes.

El rigor del estudio se garantizó mediante protocolos de codificación temática, controles de calidad estadísticos y triangulación de fuentes, consolidando así la validez y fiabilidad de los resultados presentados (Hernández-Sampieri et al., 2014).

5. Análisis de resultados

Este apartado presenta los hallazgos derivados del análisis. Los resultados se estructuran en ocho bloques temáticos que responden a los objetivos e hipótesis del estudio, abordando desde los fines estratégicos de adopción hasta su impacto operativo, ético y perceptivo. Esta organización facilita el análisis comparado entre visión corporativa y percepción pública.

5.1. Adopción y objetivos estratégicos del uso de IA

Los resultados obtenidos a partir de las entrevistas cualitativas evidencian que startups y pymes están adoptando la inteligencia artificial principalmente con una lógica estratégica orientada a la optimización de sus procesos comunicativos. Esta implementación permite automatizar tareas repetitivas, personalizar contenidos y mejorar la eficiencia en la captación y fidelización de clientes.

En particular, las herramientas más utilizadas incluyen chatbots conversacionales, sistemas de recomendación, plataformas de automatización de marketing y algoritmos de segmentación predictiva. Estos recursos han sido incorporados tanto como respuesta a limitaciones operativas —en el caso de muchas pymes— como para potenciar modelos escalables en entornos altamente competitivos —en el caso de las startups—.

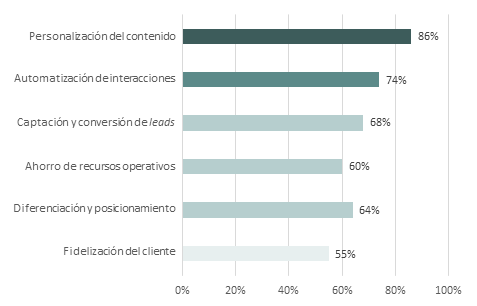

Como se muestra en la Figura 5, los objetivos estratégicos más citados por los responsables de marketing entrevistados giran en torno a tres ejes principales: la personalización de la experiencia del usuario (86%), la automatización de interacciones (74%) y la mejora de métricas como captación de leads y conversión (68%).

Figura 5. Porcentaje de startups y pymes que mencionan distintos objetivos estratégicos en la adopción de inteligencia artificial

Fuente: Elaboración propia

a partir del trabajo de campo.

Análisis: codificación temática y conteo de menciones en entrevistas

cualitativas.

Esta jerarquía evidencia una priorización clara de funciones operativas frente a objetivos más relacionales, como la fidelización del cliente (55%) o la diferenciación estratégica (64%). Este dato sugiere que, si bien la IA se reconoce como una herramienta poderosa para optimizar procesos y reducir costes, su potencial para construir relaciones duraderas o generar identidad de marca aún no se ha desarrollado plenamente en estas organizaciones. Así, la lógica de adopción parece más funcional que transformacional: se busca eficiencia, más que reinvención comunicativa o innovación narrativa.

5.2.

Impacto en métricas clave: engagement,

conversión

y personalización

La integración de IA en las estrategias de comunicación persuasiva ha tenido un impacto positivo en indicadores clave como la conversión, el engagement y la satisfacción del cliente. Estos efectos han sido respaldados tanto por los responsables de marketing entrevistados como por los consumidores encuestados. Desde la perspectiva empresarial, la automatización de procesos y la personalización algorítmica se asocian con mejoras significativas en el rendimiento de las campañas digitales. Herramientas como los motores de recomendación, los sistemas de segmentación inteligente o los chatbots conversacionales han permitido adaptar los mensajes a las necesidades específicas de cada usuario, optimizando así la interacción y el retorno comercial.

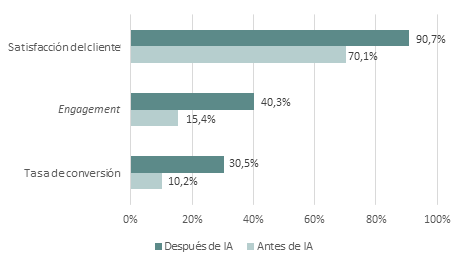

Como se muestra en la Figura 6, la mayoría de las empresas participantes reportó aumentos notables en sus tasas de conversión y niveles de engagement tras la implementación de IA. Asimismo, las encuestas reflejan una mejora clara en la percepción del cliente respecto a la experiencia digital ofrecida por estas marcas. Sin embargo, si se analizan las cifras en detalle, se observa que el mayor incremento se da en la tasa de conversión (del 10,2% al 30,5%), lo que sugiere un uso intensivo de la IA con fines de eficiencia comercial más que de relación emocional. El engagement, aunque mejora (del 15,4% al 40,3%), sigue estando por debajo de los niveles deseables, lo que podría indicar que la interacción algorítmica aún no logra generar vínculos sostenidos con los usuarios. La satisfacción del cliente, aunque alta (del 70,1% al 90,7%), puede estar condicionada por mejoras en la usabilidad y personalización, pero no necesariamente implica confianza o lealtad a largo plazo.

Figura 6. Variación en métricas de rendimiento y experiencia del cliente antes y después del uso de IA (n = 500)

Fuente: Elaboración propia

con base en encuestas a consumidores.

Análisis comparativo antes/después de la implementación de inteligencia

artificial.

Estos datos invitan a matizar el entusiasmo inicial sobre los beneficios técnicos de la IA: si bien hay mejoras objetivas, no garantizan por sí solas una relación sólida con el consumidor.

5.3. Transparencia, confianza y percepción ciudadana

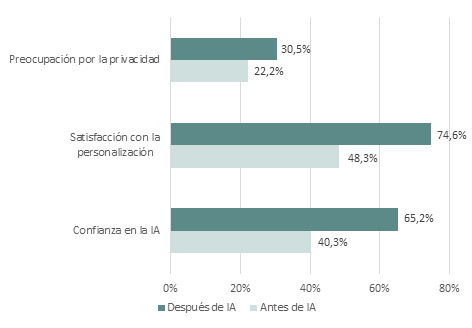

Además del impacto operativo, el estudio analizó cómo perciben los consumidores la inteligencia artificial en su relación con las marcas, especialmente en lo relativo a confianza, personalización y protección de datos personales. Si bien la personalización algorítmica es valorada positivamente en muchos casos, también genera inquietudes cuando no va acompañada de transparencia, supervisión o consentimiento informado. La Figura 7 resume los cambios en la percepción ciudadana tras interactuar con estrategias comunicativas impulsadas por IA.

Figura 7. Comparación de la percepción del consumidor antes y después de interactuar con estrategias comunicativas basadas en inteligencia artificial (n = 500)

Fuente: Elaboración propia a partir de datos recogidos en encuestas a consumidores. Análisis: comparación antes/después de la interacción con IA (resultados de encuesta).

Los resultados muestran un incremento significativo en la satisfacción con la personalización (del 48,3% al 74,6%) y en la confianza general en sistemas basados en IA (del 40,3% al 65,2%). No obstante, también aumentó la preocupación por la privacidad, pasando del 22,2% al 30,5%.

Este aumento simultáneo de la confianza y la preocupación revela una paradoja clave: aunque las interacciones algorítmicas resultan útiles y agradables para muchos consumidores, no terminan de disipar los temores sobre el uso de datos personales. El hecho de que la preocupación por la privacidad crezca en un contexto donde la satisfacción también mejora sugiere que los usuarios valoran la funcionalidad, pero desconfían del proceso que la posibilita. En otras palabras, disfrutan del “resultado”, pero siguen sin comprender —o aceptar plenamente— los “medios” tecnológicos empleados.

Esta ambivalencia pone en evidencia una brecha de información y confianza que las empresas deberán cerrar si quieren consolidar relaciones sostenibles con sus audiencias. No basta con ofrecer experiencias personalizadas: es necesario garantizar que sean también comprensibles, auditables y éticamente justificadas.

5.4. Riesgos percibidos y tensiones éticas en la comunicación automatizada

Con la consolidación de estrategias de marketing basadas en IA, emergen también tensiones éticas relevantes. Tanto profesionales como consumidores expresaron inquietudes sobre los posibles efectos adversos de la automatización persuasiva, especialmente en ausencia de supervisión o marcos éticos claros.

Uno de los riesgos más citados fue la posibilidad de manipulación emocional. Varios entrevistados alertaron del potencial de la IA para influir en decisiones del consumidor de forma excesiva, especialmente al personalizar mensajes a partir de datos sensibles o dirigidos a públicos vulnerables.

Desde el lado ciudadano, el 30,5% expresó preocupación por la opacidad en el uso de datos, y un 26% se mostró incómodo al no saber si interactuaba con una máquina o una persona. Estas respuestas reflejan una carencia de transparencia algorítmica y subrayan la necesidad de garantizar el consentimiento informado y la auditabilidad.

También preocupa la falta de supervisión humana: solo el 18% de las empresas afirmó tener mecanismos de revisión interna de sus sistemas de IA. Esta carencia aumenta los riesgos de sesgo, descontextualización y falta de responsabilidad institucional.

En definitiva, la legitimidad de la IA en comunicación no depende solo de su eficacia técnica, sino de cómo se estructura la relación con el usuario. La confianza exige no solo precisión algorítmica, sino también principios de equidad, claridad y respeto por los derechos digitales.

5.5. Divergencias

entre discurso empresarial y percepción

del consumidor

Una aportación clave del estudio es la triangulación de perspectivas entre profesionales y consumidores, que permite identificar tanto coincidencias como divergencias en torno al uso de inteligencia artificial en la comunicación persuasiva.

Desde el ámbito empresarial, más del 80% de los responsables de marketing entrevistados mostraron entusiasmo por la capacidad de la IA para mejorar eficiencia, reducir costes y optimizar campañas. La personalización algorítmica fue valorada como herramienta para fidelizar, convertir y posicionar marca.

Los consumidores, en cambio, adoptan una visión más matizada. Aunque el 74,6% se mostró satisfecho con experiencias personalizadas, el 30,5% expresó preocupación por el uso de datos personales, y un 26% desconfiaba de interacciones automatizadas no identificadas.

Además, se detecta una diferencia en la noción de confianza: para las empresas se construye desde la relevancia del mensaje; para los consumidores, desde la transparencia, el consentimiento y el control sobre la interacción. Estas diferencias muestran que la tecnología no alinea automáticamente los valores de emisores y receptores. Para que la IA en marketing sea legítima, debe construirse desde un enfoque bidireccional, equilibrando objetivos comerciales con derechos y expectativas ciudadanas.

Tabla 1. Divergencias entre discurso empresarial y percepción del consumidor

|

Aspecto |

Empresas |

Consumidores |

|

Objetivo principal |

Optimizar campañas y reducir costes |

Mejorar experiencia |

|

Percepción de la IA |

Oportunidad estratégica |

Tecnología útil, pero |

|

Confianza |

Eficiencia y rendimiento |

Depende de la claridad |

|

Transparencia |

Baja prioridad en el discurso |

Alta prioridad; piden |

|

Riesgos percibidos |

Escasa preocupación explícita |

Preocupación por |

|

Supervisión humana |

No siempre contemplada |

Requieren presencia |

Fuente: Elaboración propia. Análisis: comparación cualitativa de percepciones entre discurso empresarial y ciudadanía.

5.6. Factores clave para la confianza del usuario y condiciones éticas de adopción

La transparencia algorítmica aparece como uno de los elementos más valorados. La confianza del usuario se fortalece cuando las marcas informan de forma clara sobre el uso de IA, los datos empleados y los objetivos de la automatización. En cambio, la ausencia de esta comunicación genera desconfianza, especialmente en usuarios con menor familiaridad tecnológica.

Otro componente fundamental es la supervisión humana activa. Saber que hay personas detrás del sistema que monitorean y validan las decisiones algorítmicas incrementa notablemente la legitimidad del proceso y la tranquilidad del usuario. Asimismo, los participantes reclaman un consentimiento informado real, que vaya más allá del típico checkbox legal. Se espera que las plataformas ofrezcan opciones claras para desactivar recomendaciones o limitar el uso de datos, fomentando así el control por parte del usuario.

En el plano ético, se señala la importancia de evitar prácticas manipulativas. El diseño persuasivo debe respetar la autonomía del individuo, evitando explotar vulnerabilidades emocionales, especialmente en contextos sensibles como salud, finanzas o educación.

Por último, tanto empresas como consumidores advierten la necesidad de una mayor formación ética y educomunicativa, que permita comprender los alcances, riesgos y límites de la IA. Solo uno de cada cinco profesionales entrevistados había recibido algún tipo de capacitación ética sobre el uso de IA, lo que evidencia una carencia formativa preocupante. Estos factores serán la base sobre la que se propone, en el siguiente apartado, un modelo de implementación responsable de la inteligencia artificial en estrategias de marketing y comunicación.

5.7. Propuesta de modelo de implementación responsable

A partir de los resultados obtenidos, se propone un modelo de referencia para la implementación ética de IA en marketing y comunicación persuasiva, especialmente diseñado para startups y pymes. Su adopción progresiva no solo puede mejorar métricas como conversión o engagement, sino también consolidar una relación de confianza con las audiencias, generando marcas más responsables y alineadas con los principios de la educomunicación.

La Tabla 2 sintetiza los cinco ejes estratégicos que conforman este modelo de implementación responsable, integrando hallazgos cualitativos y cuantitativos del estudio. Cada eje representa una dimensión clave —transparencia, supervisión humana, consentimiento informado, ética persuasiva y formación crítica— orientada a equilibrar eficacia comunicativa y responsabilidad social en el uso de la IA.

Tabla 2. Modelo ético de IA para entornos de comunicación digital

|

Nº |

Eje estratégico |

Descripción |

|

1 |

Transparencia proactiva |

Informar explícitamente al usuario sobre el uso de IA y su finalidad |

|

2 |

Supervisión humana integrada |

Incluir responsables que monitoricen, |

|

3 |

Consentimiento informado real |

Diseñar sistemas que permitan al usuario decidir cómo se usan sus datos |

|

4 |

Ética persuasiva aplicada |

Evitar manipulación emocional o diseño |

|

5 |

Formación y cultura crítica |

Capacitar a equipos y usuarios en |

Fuente: Elaboración propia.

Análisis: síntesis de hallazgos cualitativos y cuantitativos

del estudio (propuesta derivada de los resultados).

5.8. Síntesis final de resultados: Conexión entre objetivos, hipótesis y hallazgos

Este subapartado integra de manera estructurada los principales objetivos del estudio, los hallazgos derivados del trabajo empírico y su vínculo con las hipótesis planteadas, permitiendo una lectura crítica del aporte científico del artículo. Asimismo, se refuerza la interpretación de resultados a partir del análisis visual y los datos expuestos en los gráficos previos.

La Tabla 3 presenta la relación entre los objetivos del estudio, las hipótesis contrastadas y los hallazgos empíricos más relevantes, facilitando una visión sintética de la coherencia interna entre las fases cualitativa y cuantitativa del diseño metodológico.

Tabla 3. Relación entre objetivos del estudio, hallazgos empíricos e hipótesis contrastadas

|

Objetivo del estudio |

Hipótesis relacionada |

Hallazgos principales |

|

OE1. Analizar cómo las startups y pymes integran la IA en sus estrategias de comunicación persuasiva y marketing digital. |

H1. La implementación de sistemas de IA en marketing digital mejora significativamente la tasa de conversión en startups y pymes. |

El 86 % de las empresas utiliza IA para personalizar contenidos, el 74 % para automatizar interacciones y el 68 % para optimizar métricas de conversión. Esto confirma su uso estratégico orientado a eficiencia más que a innovación comunicativa. |

|

OE2. Evaluar el impacto de la IA en métricas clave como la conversión, el engagement y la satisfacción del cliente. |

H2. El uso de IA para la personalización de mensajes incrementa el engagement y la satisfacción del cliente. |

La tasa de conversión aumentó del 10,2 % al 30,5 %, el engagement del 15,4 % al 40,3 % y la satisfacción del cliente del 70,1 % al 90,7 %, confirmando mejoras significativas tras integrar IA en campañas. |

|

OE3. Explorar la percepción de los consumidores ante los mensajes personalizados generados por sistemas de IA. |

H3. La percepción positiva hacia la IA se asocia con altos niveles de transparencia y comunicación ética por parte de las marcas. |

El 74,6 % de los consumidores valoró positivamente la personalización, aunque el 30,5 % expresó preocupación por la privacidad. La confianza en la IA pasó del 40,3 % al 65,2 %, evidenciando una aceptación condicionada por la transparencia. |

|

OE4. Identificar los principales riesgos éticos asociados al uso de IA en comunicación, incluyendo privacidad, sesgos y autonomía del usuario. |

H4. La ausencia de supervisión humana en los sistemas basados en IA genera desconfianza y reduce la efectividad comunicativa. |

Solo el 18 % de las empresas cuenta con revisión interna de sus sistemas de IA. El 30,5 % de los usuarios manifestó preocupación por la opacidad en el uso de datos y el 26 % por no saber si interactuaba con humanos o máquinas. |

|

OE5. Proponer un modelo de implementación responsable de IA que combine eficacia comunicativa, supervisión humana y principios éticos. |

H5. La adopción de un modelo híbrido que combine IA con control humano fortalece la confianza del consumidor y mejora la relación marca-audiencia. |

Se valida un modelo de implementación responsable basado en transparencia, supervisión y formación crítica, que equilibra eficacia persuasiva y ética comunicativa. |

Fuente: Elaboración propia a partir de los resultados cualitativos y cuantitativos obtenidos en entrevistas (n = 50) y encuestas (n = 500). Análisis: integración interpretativa mediante triangulación de datos.

La síntesis presentada en la Tabla 3 permite establecer una conexión directa entre los objetivos, los hallazgos y las hipótesis del estudio, evidenciando la coherencia metodológica del diseño secuencial y la solidez empírica de los resultados. A partir de esta integración, el siguiente apartado desarrolla las conclusiones generales del trabajo, profundizando en el cumplimiento del objetivo principal y en la validación de los objetivos específicos planteados.

6. Conclusiones

Esta investigación ha permitido analizar de forma integral el impacto de la inteligencia artificial en la comunicación persuasiva de startups y pymes españolas. El estudio abordó dimensiones esenciales como la personalización de contenidos, la eficiencia en campañas, la confianza del usuario, los riesgos de automatización persuasiva y la necesidad de incorporar marcos éticos en el diseño tecnológico. Este apartado final sintetiza los principales hallazgos, respondiendo al objetivo general, a los objetivos específicos y a las hipótesis formuladas.

6.1. Cumplimiento del objetivo general

El objetivo general del estudio fue analizar el impacto de la inteligencia artificial en la comunicación persuasiva digital, considerando su capacidad para personalizar mensajes, mejorar la eficacia del marketing y generar confianza, así como los riesgos éticos asociados, especialmente en torno a privacidad, manipulación y equidad.

Los resultados evidencian que la IA ha pasado de ser una herramienta operativa, a consolidarse como un recurso estratégico en la relación entre marcas y audiencias, coherente con lo observado por Longoni et al. (2019) y Floridi et al. (2018), quienes sostienen que la confianza en la automatización comunicativa depende más de la percepción ética que del rendimiento técnico.

En línea con Afroogh et al. (2024) y Sebastião & Dias (2025), este estudio confirma que la aceptación de la IA persuasiva se apoya en tres pilares: transparencia, control humano y consentimiento informado. Aunque startups y pymes logran mejoras en eficiencia y personalización, la confianza del usuario no deriva de la sofisticación algorítmica, sino del grado de explicabilidad y responsabilidad percibida en su implementación. Así, la eficacia técnica no garantiza por sí sola la legitimidad comunicativa. En contextos internacionales, como los analizados por Ngo (2025) en Asia y Laux et al. (2024) en Europa, se observa una tendencia convergente hacia la exigencia de transparencia algorítmica como elemento clave de la confianza digital.

En síntesis, la IA potencia la eficacia de la comunicación persuasiva, pero su legitimidad depende de la integración de principios éticos y normativos que garanticen explicabilidad y respeto a los derechos digitales. Este hallazgo refuerza la necesidad de alinear las prácticas empresariales con marcos como el AI Act europeo (Regulation 2024/1689), que promueve la transparencia y la supervisión humana en los sistemas de IA aplicados a la comunicación.

6.2. Cumplimiento de los objetivos específicos

El análisis de los cinco objetivos específicos permite articular una visión crítica sobre cómo startups y pymes españolas están utilizando la inteligencia artificial en la comunicación persuasiva, integrando perspectivas éticas, tecnológicas y comunicativas.

En primer lugar, los resultados sobre integración tecnológica (OE1) confirman que la adopción de IA es desigual entre startups y pymes (Sebastião & Dias, 2025). Las primeras la conciben como una ventaja estructural desde fases tempranas, mientras que las segundas la aplican con fines más operativos. Este patrón coincide con evidencias internacionales que vinculan la madurez organizativa con la comprensión ética de la automatización (Ngo, 2025; Laux et al., 2024.

En segundo lugar (OE2), en cuanto al impacto operativo, la IA muestra una correlación positiva con indicadores de conversión, engagement y satisfacción del cliente (Afroogh et al., 2024). Sin embargo, como advierten Longoni et al. (2019), la efectividad técnica pierde valor cuando el usuario percibe falta de transparencia o supervisión. En la muestra, los beneficios cuantificables solo se transformaron en legitimidad comunicativa cuando el consumidor percibía control y explicabilidad.

En relación con la percepción del consumidor (OE3), los resultados refuerzan que la personalización es bien aceptada siempre que exista claridad sobre el origen y propósito de los mensajes. Los consumidores valoran la IA en la medida en que comprenden su funcionamiento y pueden intervenir en la configuración de la experiencia (Ngo, 2025), lo que confirma que la transparencia algorítmica es condición necesaria para la aceptación de la IA en marketing.

El cuarto objetivo, relativo a la identificación de los riesgos éticos (OE4), evidencia la persistencia de riesgos asociados a la manipulación emocional, el uso opaco de datos y la falta de revisión humana. En consonancia con Floridi et al. (2018), la ética en IA debe desplazarse de la responsabilidad técnica a la comunicativa: la ausencia de formación ética y auditorías comunicacionales genera desconfianza incluso en organizaciones tecnológicamente avanzadas.

Finalmente, el OE5, que plantea la contribución principal del estudio, propone un modelo de implementación responsable de IA basado en cinco ejes —transparencia, supervisión humana, consentimiento informado, ética persuasiva y formación crítica— que refuerza los principios del AI Act europeo y la Carta de Derechos Digitales (Gobierno de España, 2021). Este modelo se alinea con la tendencia hacia una IA confiable y socialmente responsable, ofreciendo un marco operativo para comunicadores y marketers.

Desde una perspectiva aplicada, se proponen acciones concretas: diseñar campañas auditables que informen explícitamente del uso de IA, incorporar mecanismos de revisión humana en cada fase del proceso persuasivo, fomentar la alfabetización algorítmica en los equipos de marketing y promover códigos éticos específicos para la comunicación automatizada. Estas medidas fortalecen la legitimidad social y la resiliencia reputacional de las marcas en entornos digitales cada vez más automatizados.

No obstante, deben reconocerse varias limitaciones. La muestra presenta un sesgo de alto perfil digital —empresas con mayor madurez tecnológica—, un tamaño no representativo y escasa diversidad sectorial, concentrándose en el contexto español. Esto limita la generalización de los hallazgos y plantea la necesidad de contrastar resultados en entornos internacionales con distintos grados de desarrollo regulatorio y cultural. Futuras líneas de investigación deberían explorar comparaciones longitudinales y transnacionales (Europa–Latam, Europa–Asia) que permitan medir la evolución de la confianza y la ética percibida en el uso de IA persuasiva. Además, se recomienda integrar metodologías experimentales y neurométricas para analizar la respuesta emocional del consumidor ante distintos grados de transparencia y control algorítmico.

En conjunto, este bloque analítico consolida una síntesis conceptual: la eficacia de la IA en comunicación persuasiva depende tanto de su capacidad técnica como de su integración ética, comunicativa y regulatoria, configurando un modelo híbrido IA + control humano como estándar de confianza digital.

6.3. Conclusión final

Este estudio demuestra que la inteligencia artificial ha dejado de ser una herramienta marginal para convertirse en un actor clave en la comunicación persuasiva digital, especialmente en el ecosistema de startups y pymes españolas. Su implementación impacta positivamente en variables como la conversión, la personalización y la satisfacción del cliente, aunque su legitimidad depende más de la integración ética y comunicativa que de la capacidad técnica.

El contraste entre el discurso empresarial y la percepción ciudadana revela un consenso creciente: la IA es valorada solo cuando se emplea de forma transparente, controlada y respetuosa con la autonomía del usuario. Este hallazgo coincide con lo planteado por Longoni et al., (2019) y Afroogh et al., (2024), quienes sostienen que la confianza en los sistemas inteligentes se fundamenta en la explicabilidad y la supervisión humana.

La principal aportación de este estudio radica en la propuesta de un modelo responsable de implementación de IA en marketing, construido a partir de evidencias empíricas y fundamentado en cinco ejes: transparencia, supervisión humana, consentimiento informado, ética persuasiva y formación crítica. Este modelo contribuye a cerrar la brecha entre la eficiencia técnica y la legitimidad social, y se alinea con los principios del AI Act europeo (Regulation 2024/1689) y la Carta de Derechos Digitales (Gobierno de España, 2021), reforzando los valores de transparencia, responsabilidad y protección de la autonomía digital.

En definitiva, la inteligencia artificial se consolida como motor de la comunicación persuasiva contemporánea, pero su legitimidad dependerá de la capacidad de las organizaciones para integrar ética, transparencia y control humano en cada interacción. Este estudio sienta las bases para una práctica de marketing digital más transparente, humanizada y centrada en la confianza, en coherencia con las exigencias regulatorias y sociales de la nueva era algorítmica.

Ética y transparencia

Agradecimientos

Agradecemos a la Universidad Camilo José Cela el apoyo institucional brindado para la realización de este estudio. Agradecemos igualmente a la empresa Proofers la traducción del manuscrito. Finalmente, extendemos nuestro agradecimiento a los profesionales y organizaciones que participaron en las entrevistas, cuya colaboración y conocimiento resultaron fundamentales para la elaboración de los resultados.

Conflicto de intereses

Los autores de este artículo declaran que no existe ningún conflicto de intereses.

Financiación

Esta investigación no ha recibido financiación específica de ninguna entidad pública o privada.

Contribuciones de los autores

|

Función |

Autor 1 |

Autor 2 |

Autor 3 |

Autor 4 |

|

Conceptualización |

X |

X |

|

|

|

Curación de datos |

X |

|

|

|

|

Análisis formal |

X |

X |

|

|

|

Adquisición de financiamiento |

|

X |

|

|

|

Investigación |

X |

|

|

|

|

Metodología |

X |

|

|

|

|

Administración de proyecto |

|

X |

|

|

|

Recursos |

|

X |

|

|

|

Software |

X |

|

|

|

|

Supervisión |

|

X |

|

|

|

Validación |

|

X |

|

|

|

Visualización |

X |

X |

|

|

|

Escritura - borrador original |

X |

|

|

|

|

Escritura - revisión y edición |

|

X |

|

|

Disponibilidad de los datos

Para la disponibilidad de los datos, se debe contactar con los autores.

Referencias bibliográficas

Afroogh, S., Akbari, A., Malone, E. et al. (2024). Trust in AI: progress, challenges, and future directions. Humanities and Social Sciences Communications, 11, 1568. https://doi.org/10.1057/s41599-024-04044-8

Bryman, A. (2016). Social Research Methods (5th ed.). London: Oxford University Press.

Comisión Europea (2020). Guía del usuario sobre la

definición del concepto de pyme. Oficina de Publicaciones de la Unión

Europea.

https://tinyurl.com/42u68d2h

Creswell, J. W. & Plano Clark, V. L. (2017). Designing and Conducting Mixed Methods Research (3ª ed.). SAGE Publications.

Davenport, T., Guha, A., Grewal, D. & Bressgott, T. (2020). How artificial intelligence will change the future of marketing. Journal

of the Academy of Marketing Science, 48, 24-42.

https://doi.org/10.1007/s11747-019-00696-0

Eubanks, V. (2018). Automating Inequality: How High-Tech Tools Profile, Police, and Punish the Poor. St. Martin’s Press.

European Court of Auditors (2024). Special

report 08/2024: EU Artificial intelligence ambition. European Union Publications.

https://tinyurl.com/2fuzenny

European Commission (2024). More support for artificial intelligence start-ups to boost innovation. [Press release]. https://tinyurl.com/4hhyzz7t

European

Union (2024). Regulation (EU)

2024/1689 of the European Parliament and of the Council of 13 June 2024 laying

down harmonised rules on artificial intelligence (Artificial Intelligence Act). Official Journal of the European Union, L (12 July 2024).

https://eur-lex.europa.eu/eli/reg/2024/1689/oj

Eurostat (2025). Usage of AI technologies increasing in EU enterprises. European Commission. https://tinyurl.com/2edbym55

Fernández-Fernández, J. L. & Pinillos, A. (2011). De la RSC a la sostenibilidad corporativa: Una evolución necesaria para la creación de valor. Harvard Deusto Business Review, 204, 50-57.

Floridi, L., Cowls, J., Beltrametti, M., Chatila, R., Chazerand, P., Dignum, V. ... & Vayena, E. (2018). AI4People—An ethical framework for a good AI society: Opportunities, risks, principles, and recommendations. Minds and Machines, 28(4), 689707. https://doi.org/10.1007/s11023-018-9482-5

Gobierno de España (2021). Carta de Derechos Digitales. Secretaría de Estado de Digitalización e Inteligencia Artificial. https://tinyurl.com/zddf5vta

Grewal, D. & Roggeveen, A. L. (2017). The future of retailing. Journal of Retailing, 93(1), 1-6. https://doi.org/10.1016/j.jretai.2016.12.008

Gunning, D. & Aha, D. W. (2019). DARPA’s explainable artificial intelligence (XAI) program. AI Magazine, 40(2), 44-58. https://doi.org/10.1609/aimag.v40i2.2850

Hair, J. F., Risher, J. J., Sarstedt, M. & Ringle, C. M. (2019). When to use and how to report the results of PLS-SEM. European Business Review, 31(1), 2-24. https://doi.org/10.1108/EBR-11-2018-0203

Hernández-Sampieri, R., Fernández-Collado, C. & Baptista-Lucio, P. (2014). Metodología de la investigación (6ª ed.). McGraw-Hill.

IndesIA (2024). Barómetro de adopción de la inteligencia artificial en las pymes españolas: Edición 2024. Asociación para la Digitalización de la Industria Española. https://www.indesia.org/barometro-ia-v8-1/

Jauregui Caballero, A. & Ortega Ponce, C. (2020). Transmedia storytelling in the social appropriation of knowledge. Revista Latina de Comunicación Social, 77, 357-372. https://doi.org/10.4185/RLCS-2020-1462

Kaplan, Andreas & Haenlein, Michael (2019). Rulers of the world, unite! The challenges and opportunities of artificial intelligence. Business Horizons, 63(1), 37-50. https://doi.org/ 63. 10.1016/j.bushor.2019.09.003

Kumar, V., Ramachandran, D. & Kumar, B. (2021). Influence of new-age technologies on marketing: A research agenda. Journal of Business Research, 125, 864-877. https://doi.org/10.1016/j.jbusres.2020.01.007

Lee, M. C. M., Scheepers, H., Lui, A. K. H. & Ngai, E. W. T. (2023). The implementation of artificial intelligence in organizations: A systematic literature review. Information & Management, 60(5), 103816. https://doi.org/10.1016/j.im.2023.103816

Longoni, C., Bonezzi, A. & Morewedge, C. K. (2019). Resistance to medical artificial intelligence. Journal of Consumer Research, 46(4), 629-650. https://doi.org/10.1093/jcr/ucz013

Mittelstadt, B. D., Allo, P., Taddeo, M., Wachter, S. & Floridi, L. (2016). The ethics of algorithms: Mapping the debate. Big Data & Society, 3(2). https://doi.org/10.1177/2053951716679679

Nagamini, E. & Aguaded, I. (2018). La educomunicación en el contexto de las nuevas dinámicas discursivas mediáticas. Revista Mediterránea de Comunicación, 9(2), 119-121. https://doi.org/10.14198/MEDCOM2018.9.2.27

Ngo, V. M. (2025). Balancing AI transparency: Trust, Certainty, and Adoption. Information Development, 0(0). https://doi.org/10.1177/02666669251346124

Raji, I. D., Smart, A., White, R. N., Mitchell, M., Gebru, T., Hutchinson, B. ... & Barnes, P. (2020). Closing the AI accountability gap: Defining an end-to-end framework for internal algorithmic auditing. In Proceedings of the 2020 Conference on Fairness, Accountability, and Transparency (FAT '20) (pp. 33-44). Association for Computing Machinery. https://doi.org/10.1145/3351095.3372873

Red.es (2023). La transformación digital en la pyme española: Informe de resultados del Programa Oficinas Acelera pyme. Entidad Pública Empresarial Red.es. https://tinyurl.com/73uh5ux4

Ries, E. (2011). The Lean Startup: How Today's Entrepreneurs Use Continuous Innovation to Create Radically Successful Businesses. Crown Business.

Russell, S. J. & Norvig, P. (2020). Artificial Intelligence: A Modern Approach (4ª ed.). Pearson Education.

Sebastião, S. & Dias, D. (2025). AI Transparency: A Conceptual, Normative, and Practical Frame Analysis. Media and Communication, 13, Article 9419. https://doi.org/10.17645/mac.9419

Sundar, S. S. (2020). Rise of machine agency: A framework for studying the psychology of human–AI interaction. Journal of Computer-Mediated Communication, 25(1), 74-88. https://doi.org/10.1093/jcmc/zmz026

Suraña‐Sánchez, C. & Aramendia‐Muneta, M. E. (2024). Impact of artificial intelligence on customer engagement and advertising engagement: A review and future research agenda. International Journal of Consumer Studies, 48(3), e13027. https://doi.org/10.1111/ijcs.13027

Tadimarri, A., Gurusamy, A., Sharma, K. K. & Jangoan, S. (2024). AI-powered marketing: Transforming consumer engagement and brand growth. International Journal for Multidisciplinary Research, 6(2). https://doi.org/10.36948/ijfmr.2024.v06i02.14595

Torres-Toukoumidis, Á., Santín Picoita, F. & Henríquez Mendoza, E. (2024). Inteligencia artificial y educomunicación. https://doi.org/10.52495/c2.emcs.23.ti12

Yin, R. K. (2017). Case Study Research and Applications: Design and Methods. SAGE Publications.

Zarouali, B., Boerman, S. C., Voorveld, H. A. M. & van Noort, G. (2022). The algorithmic persuasion framework in online communication: Conceptualization and a future research agenda. Internet Research, 32(4), 1076-1096. https://doi.org/10.1108/INTR-01-2021-0049

Zozaya Durazo, L. D., Feijoo Fernández, B. & Sádaba Chalezquer, C. (2022). Análisis de la capacidad de menores en España para reconocer los contenidos comerciales publicados por influencers. Revista de Comunicación, 21(2), 307-319. https://doi.org/10.26441/RC21.2-2022-A15